Este audio se genera automáticamente. Por favor, háganos saber si tiene algún comentario.

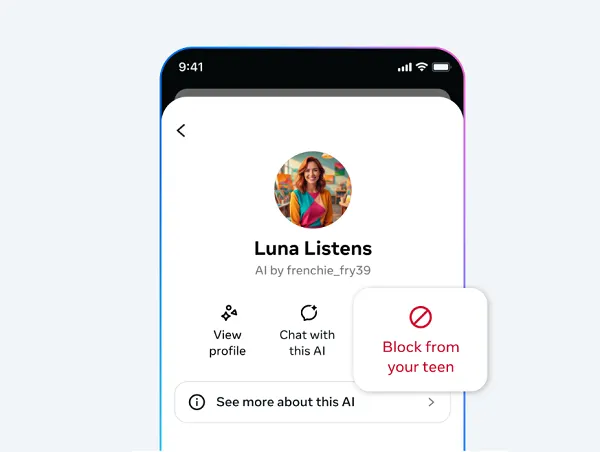

Meta está prohibiendo el acceso de los adolescentes a sus chatbots de IA en diferentes personas, ya que busca implementar un nuevo sistema que garantizará una mayor seguridad en su uso y abordará las preocupaciones sobre los adolescentes que reciben consejos perjudiciales de estas opciones.

Lo cual tiene sentido, dadas las preocupaciones ya planteadas sobre la interacción de los robots de IA, pero en realidad, estas se aplicarían a todos, no solo a los usuarios adolescentes.

En octubre, Meta lanzó algunas opciones nuevas para que los padres controlen cómo sus hijos interactúan con los perfiles de IA en sus aplicaciones, en medio de preocupaciones de que algunos chatbots de IA estuvieran brindando consejos y orientación potencialmente dañinos a los adolescentes.

De hecho, se ha descubierto que varios chatbots de IA brindan a los adolescentes orientación peligrosa sobre autolesiones, trastornos alimentarios, cómo comprar drogas (y ocultárselas a sus padres), etc.

Eso provocó el lanzamiento de una investigación de la FTC sobre los riesgos potenciales de la interacción de los chatbots de IA y, en respuesta a eso, Meta agregó más opciones de control que permitirían a los padres limitar la forma en que sus hijos interactúan con sus chatbots de IA, para mitigar la posible preocupación.

Para ser claros, Meta no está solo en esto. Snapchat también tuvo que cambiar las reglas sobre el uso de su chatbot “My AI”, mientras que X ha tenido sus propios problemas recientes a gran escala con personas que usan su chatbot Grok para generar imágenes ofensivas.

La IA generativa todavía está en su infancia y, como tal, es prácticamente imposible para los desarrolladores contrarrestar cada posible uso indebido. Pero aun así, estos usos por parte de los adolescentes parecen bastante fáciles de predecir, lo que probablemente refleja un impulso más amplio para un desarrollo rápido por encima del riesgo.

En cualquier caso, Meta está implementando nuevos controles sobre sus robots de IA para abordar esta preocupación. Pero mientras lo hace, ahora decidió cortar temporalmente el acceso de los adolescentes a sus chatbots de IA (excepto Meta AI).

Según Meta:

“En octubre, compartimos que estamos creando nuevas herramientas para brindarles a los padres más visibilidad sobre cómo sus hijos adolescentes usan la IA y más control sobre los personajes de IA con los que pueden interactuar. Desde entonces, hemos comenzado a crear una nueva versión de personajes de IA para brindar a las personas una experiencia aún mejor. Mientras nos concentramos en desarrollar esta nueva versión, pausaremos temporalmente el acceso de los adolescentes a los personajes de IA existentes en todo el mundo”.

Quiero decir, eso no suena muy bien. Parece que se han planteado más preocupaciones, aunque claramente, la investigación de la FTC estaría jugando en las mentes de los ejecutivos de Meta, ya que se cierne una posible penalización por cualquier uso indebido.

“A partir de las próximas semanas, los adolescentes ya no podrán acceder a los personajes de IA en nuestras aplicaciones hasta que la experiencia actualizada esté lista. Esto se aplicará a cualquiera que nos haya dado un cumpleaños de adolescente, así como a las personas que afirman ser adultos pero que sospechamos que son adolescentes según nuestra tecnología de predicción de edad. Esto significa que, cuando cumplamos nuestra promesa de brindar a los padres una mayor supervisión de las experiencias de IA de sus hijos adolescentes, esos controles parentales se aplicarán a la última versión de los personajes de IA”.

Entonces Meta admite tácitamente que hay algunas fallas importantes en sus chatbots de IA, que deben abordarse. Y aunque los adolescentes aún podrán acceder a su chatbot principal Meta AI, no podrán interactuar con personas de bot personalizadas dentro de sus aplicaciones.

¿Tendrá eso un gran impacto?

Pues un estudio publicado el pasado mes de julio descubrió que el 72% de los adolescentes estadounidenses ya han utilizado un compañero de IA, y muchos de ellos ahora realizan interacciones sociales regulares con sus amigos virtuales elegidos.

Combine esto con el impulso de Meta para introducir un ejército de personas de chatbot de IA en sus aplicaciones, como un medio para impulsar la participación, y probablemente ponga un freno a sus planes más amplios.

Pero la pregunta más importante es cómo se puede salvaguardar la interacción de IA de este tipo, dado que los robots de IA están aprendiendo de Internet y ajustarán sus respuestas en función de la consulta.

Hay muchas maneras de engañar a los chatbots de IA para que te den respuestas que sus desarrolladores preferirían que no te dieran, pero debido a que coinciden con el lenguaje a una escala tan grande, es imposible tener en cuenta todas las variaciones a este respecto.

Y los adolescentes nativos digitales son extremadamente inteligentes y buscarán puntos débiles en estos sistemas.

Como tal, la medida de restringir el acceso tiene mucho sentido, pero no estoy seguro de cómo Meta podrá desarrollar salvaguardas efectivas contra preocupaciones futuras.

Entonces, tal vez simplemente no implementes chatbots de IA en diferentes personas que se presenten como personas reales.

No hay una necesidad real de ellos en ningún contexto, y también podría decirse que van en contra del aspecto “social” de las redes sociales, ya que no es “social”, en nuestra comprensión más común del término, hablar con una computadora.

Las redes sociales fueron diseñadas para facilitar la interacción humana, y el impulso para diluir eso con robots de inteligencia artificial parece estar en desacuerdo con esto. Quiero decir, entiendo por qué Meta querría hacerlo, a medida que más robots de IA interactúen como personas reales en sus aplicaciones, den me gusta a las publicaciones, dejen comentarios, todas estas cosas harán que los usuarios humanos reales se sientan especiales y fomentarán un mayor comportamiento de publicación y tiempo invertido.

Sé por qué Meta querría implementar algo así, pero no creo que se hayan evaluado completamente los riesgos, especialmente cuando se consideran los impactos potenciales de desarrollar relaciones con entidades no humanas y lo que eso podría afectar a la percepción y el estado mental de las personas.

Meta está admitiendo que esto podría ser un problema en los adolescentes. Pero en realidad, podría ser un problema generalizado y no creo que el valor de estos bots, desde la perspectiva del usuario, supere ese riesgo potencial.

Al menos hasta que sepamos más. Al menos hasta que tengamos algunos estudios a gran escala que muestren los impactos de la interacción de los robots de IA y si es algo bueno o malo para las personas.

Entonces, ¿por qué dejar de prohibirlos para los adolescentes y por qué no prohibirlos para todos hasta que tengamos más información?

Sé que esto no sucederá, pero parece una admisión de que esta es un área de preocupación más importante de lo que Meta anticipó.